Wir bringen Menschen durch KI und Automatisierung zusammen

Willkommen im Zentrum der Innovation: ein Ort, an dem KI-gesteuerte Automatisierung für kollaborative menschliche Erfahrungen genutzt wird.

Unser Bildungszentrum ist so konzipiert, dass wir Sie bei der Navigation in den Bereichen KI und AV unterstützen. Lesen Sie unseren AZ-Leitfaden zur VisionSuite oder lesen Sie unsere Blogs und unser Learning-on-Demand, in dem es darum geht, KI einfach und zugänglich zu machen.

Bereit, die KI im AV-Bereich zu erkunden? Nehmen Sie an einem unserer bevorstehenden Webinare teil und werden Sie zu einem Vordenker, der die Zukunft gestaltet.

LernenOn Demand

VisionSuite von A-Z

Klicken Sie auf den jeweiligen Buchstaben, um mehr zu erfahren

Automatische Anpassung des digitalen Zooms der Kamera, um die erkannten Personen im Bild zu zentrieren. Diese Funktion passt den Rahmenabstand an, wenn Teilnehmer beitreten oder verlassen, und ermöglicht Nahaufnahmen für entfernte Teilnehmer.

Fungieren als Sensoren, um intelligentes Umschalten zwischen aktiven Sprechern zu ermöglichen. Basierend auf den vertikalen und horizontalen Winkeldaten dieser Mikrofone löst Q-SYS dynamisch aus und wechselt zwischen benutzerdefinierten Kamerapresets.

Versteht, was im Raum passiert, und übersetzt es in ein allgemeines Verständnis. Verarbeitet Frame-Sequenzen, um die Dynamik von Szenen zu verstehen, Bewegungen vorherzusagen und zwischen Erkennungen zu differenzieren.

Ein Bewegungsbereich um den Kopf des Vortragenden, in dem keine Reaktion erfolgt. Verhindert, dass kleinere Bewegungen unnötige Kameraanpassungen verursachen.

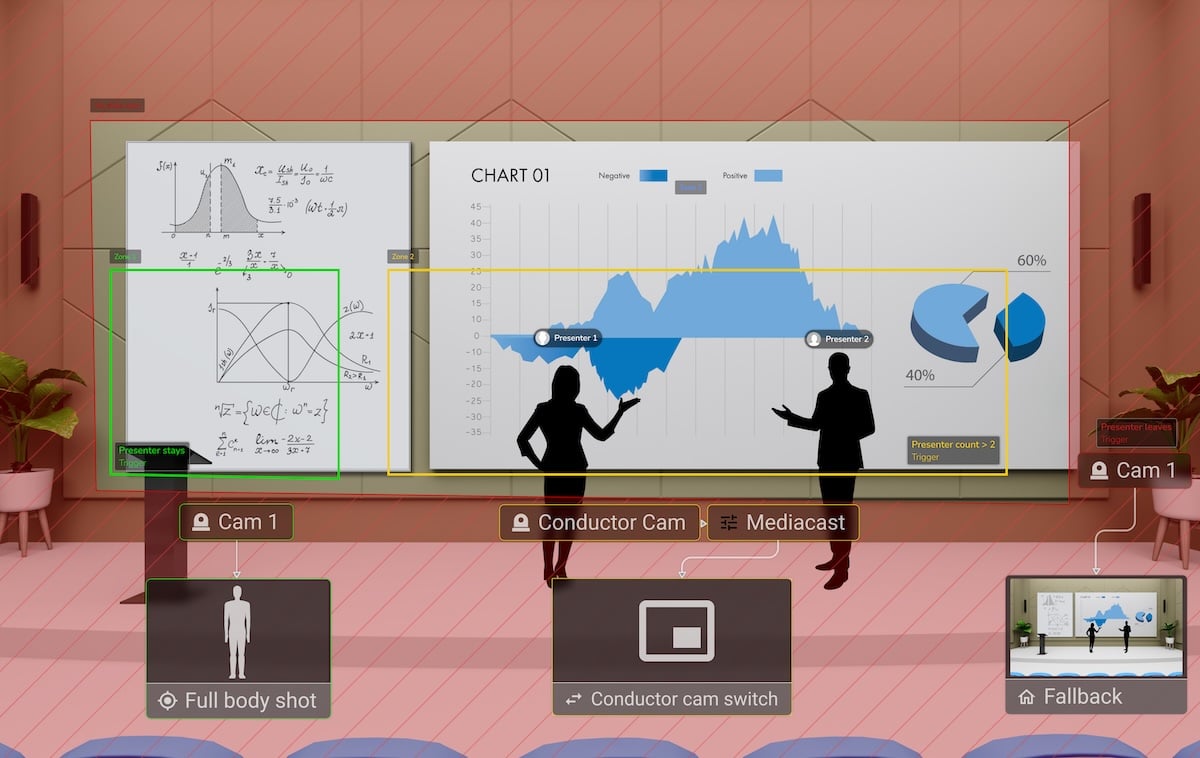

Der Seervision KI Beschleuniger versteht die visuelle Umgebung in Echtzeit und sendet sowie empfängt Ereignis-Trigger basierend auf den Positionen der Personen auf der Bühne. Ermöglicht endlose Raumautomatisierungsmöglichkeiten.

VisionSuite analysiert mehr als 20 verschiedene Referenzpunkte am gesamten Körper jeder erkannten Person. Identifiziert eine Person selbst dann zuverlässig, wenn die Hälfte ihres Körper verdeckt ist.

VisionSuite erkennt mehrere Präsentatoren und versteht Gruppendynamiken, indem es verschiedene Aufnahmen basierend auf der Anzahl der Personen auf der Bühne und deren relativen Positionen auslöst.

Dynamische, skalierbare Besprechungsräume, die ein immersives und ansprechendes Erlebnis für Teilnehmer im Raum und in hybriden Meetings bieten. VisionSuite eignet sich für Räume mit hohen Anforderungen an Audio, Video und Steuerung.

Mit Q-SYS vernetztem Video und intelligenten Beamforming-Mikrofonen können Sie das hybride Zusammenarbeitserlebnis anpassen, indem Sie nahtlos zwischen Präsentatoren- und Publikums-Kameras wechseln.

Mit Trigger-Zonen wird der erforderliche Aufwand für einen Präsentator minimiert, um seine Präsentation zu starten. Beim Betreten reagiert die Technologie eigenständig, ohne dass die Präsentatoren Touchpanels verwenden oder Tasten drücken müssen.

Die Keypoint-Erkennung ermöglicht die Identifizierung spezifischer Punkte bei Personen, wie z.B. Gelenke oder Mimik-Features, um ihren gesamten Körper zu erkennen. VisionSuite nutzt die Keypoint-Erkennung für die präzise Verfolgung und Analyse menschlicher Bewegungen

Unsere Algorithmen sind darauf abgestimmt, die Verzögerung zwischen dem Erfassen eines Bildes durch die Kamera und dem Extrahieren der notwendigen visuellen Informationen durch unser System zu kompensieren, indem sie auf die vorhergesagte Bewegung der verfolgten Person reagieren.

VisionSuite nutzt maschinelles Lernen, um unsere Modelle kontinuierlich weiterzuentwickeln und zu verbessern. Von der Markierung bis zum Training ist es das Ziel, die Leistung der Detektion und Identifizierung von Personen stets zu optimieren.

Integrieren Sie die Kameras der NC-Serie nahtlos in Q-SYS-Systeme, um das Routing der Kamera-Feeds ohne komplexe Programmierung zu vereinfachen, und liefern Sie diese Video-Feeds über Q-SYS AV-Bridging-Peripheriegeräte an Microsoft Teams, Zoom, Google Meet und Cisco Webex.

Die orchestrierte Raumsteuerung von VisionSuite koordiniert Kameras, Audio, Displays, Beleuchtung und andere Raumelemente, um eine nahtlose und optimierte Umgebung für die Zusammenarbeit zu schaffen.

Abkürzung für Pan, Tilt, Zoom (Schwenken, Neigen, Zoomen). VisionSuite nutzt die PTZ-Kameras der NC-Serie, um die Kameraansichten dynamisch anzupassen und den Moderatoren mit fließenden Bewegungen zu folgen, um den Zuschauern ein optimales Erlebnis zu bieten.

Q-SYS Designer ist das Gehirn Ihres VisionSuite-Systems, mit dem Sie Ihren gesamten AV-Stack entwerfen, konfigurieren und steuern können.

Stellen Sie sich einen Raum vor, in dem das Licht gedimmt wird, die Projektoren heruntergefahren, die Mikrofone aufgedreht werden und die Kameras den Redner in dem Moment heranzoomen, in dem er das Podium betritt - und das alles, ohne eine einzige Taste zu drücken. Das ist Raumautomation.

Der KI-Beschleuniger von Seervision nutzt die Computer-Vision-Szenenanalyse, um eine erstklassige Kameraautomatisierung zu liefern, indem er Live-Video-Feeds analysiert, um zu verstehen, was in der Szene passiert.

Die Tracking-Fähigkeiten von VisionSuite ermöglichen es den Kameras, den Vortragenden automatisch zu folgen, dank der Ganzkörpererkennung selbst unter schwierigen Bedingungen .

Unsere Wahrnehmungsalgorithmen verwenden eine komplexe Struktur von Gesichts- und Körpermerkmalen, um die Personen im Bild eindeutig zu identifizieren und ihnen eine eindeutige Kennung (ID) zu geben.

Q-SYS VisionSuite ist eine intelligente Audio-, Video- und Raumautomationslösung. Es verbessert die Sichtbarkeit der Teilnehmer im Raum und fördert ein natürliches Seherlebnis für die Gegenseite, wodurch die Einheit und das Engagement des Teams unabhängig vom Standort gefördert werden.

Verschiedene Triggerzonen können um einen Bereich herum platziert werden, um verschiedene Automatisierungen auszulösen. Ein großartiger Anwendungsfall ist der Whiteboard-Schalter. Sobald der Vortragende eine Whiteboard-Zone betritt, wird automatisch ein Kameraschalter ausgelöst.

Ok, das hört sich nur so an, als würde es mit einem X beginnen... Ausschlussbereiche ermöglichen es VisionSuite, Erkennungen auf festgelegten Bereichen zu ignorieren, was eine zuverlässige Identifizierung von Moderatoren ermöglicht, selbst wenn das System unerwünschte Objekte auf Displays oder Fenstern erkennt.

Sperren Sie die y-Achse der Kamera (Neigungsbewegung) beim Tracking. Dies ist ideal, wenn sich die Vortragenden seitlich bewegen und Sie sie nur auf einer einzigen Ebene verfolgen möchten.

Von Trigger-Zonen bis hin zu Tracking-Zonen - Zonen sind in VisionSuite allgegenwärtig. Triggerzonen sind freistehende virtuelle Zonen, die um den Präsentationsbereich herum platziert werden und die automatische Auslösung von benutzerdefinierten Aufnahmen, Kameraverhalten oder externen Ereignissen ermöglichen.